����������

���nj�(du��)��3D�c(di��n)�������(sh��)��(j��)����Ѹ�����L(zh��ng)�����Џ�2D��3D�l(f��)չ��څ��(sh��)��������opencv�о��ѽ�(j��ng)����������3D�c(di��n)�Ƶ�̎�������P(gu��n)ģ�K��������ڔ�(sh��)��(j��)�����c(di��n)�Ƶī@ȡҲ���ж�N���������� �oՓ��Դ��CADģ��߀�ǁ���LiDAR��������RGBD���C(j��)�Ē����c(di��n)�ƣ��o̎���ڡ� ���⣬�����(sh��)ϵ�y(t��ng)ֱ�ӫ@ȡ3D�c(di��n)�ƶ������Ĕz�D���M(j��n)��̎����������������ȌW(xu��)��(x��)�����������(y��ng)ԓ��Α�(y��ng)���@Щ�����@�@����ȌW(xu��)��(x��)���ߣ���3D�c(di��n)���ϵ�̎�����_(d��)����(du��)���S�D���ǘ��ܺõ����������

3D�c(di��n)�Ƒ�(y��ng)����ȌW(xu��)��(x��)���R������(zh��n)������������(j��ng)�W(w��ng)�j(lu��)�����R������(zh��n)��

��1���ǽY(ji��)��(g��u)����(sh��)��(j��)���o�W(w��ng)���c(di��n)���Ƿֲ��ڿ��g�е�XYZ�c(di��n)�� �]�нY(ji��)��(g��u)���ľW(w��ng)������CNN�V������

��2����׃�����У��c(di��n)�Ʊ��|(zh��)����һ�L(zh��ng)���c(di��n)��nx3������������n���c(di��n)��(sh��)���� �ڎ��ϣ��c(di��n)�����Ӱ����ڵӾ�ꇽY(ji��)��(g��u)�еı�ʾ��ʽ������������� ��ͬ���c(di��n)�ƿ����Ƀɂ�(g��)��ȫ��ͬ�ľ�ꇱ�ʾ������ ���D��ʾ��

��3���c(di��n)�Ɣ�(sh��)���ϵ�׃�����ڈD��������������صĔ�(sh��)����һ��(g��)�o���ij���(sh��)����ȡ�Q�����C(j��)�� Ȼ��������c(di��n)�ƵĔ�(sh��)�����ܕ�(hu��)�кܴ��׃�����@ȡ�Q�ڸ��N�����������

���c(di��n)�Ɣ�(sh��)��(j��)���������(zh��n)��

��1��ȱ�ٔ�(sh��)��(j��)�������ģ��ͨ�����ړ�������?j��n)?sh��)��(j��)�Gʧ�������

��2�����������Ђ������������s��������� �ЎN��͵�������������c(di��n)�Ɣ_��(d��ng)�ͮ���ֵ���� �@��ζ��һ��(g��)�c(di��n)��һ���ĸ���λ�������ɘӵĵط����_��(d��ng)��������ijһ�돽������(n��i)�����������ܳ��F(xi��n)�ڿ��g������λ�ã�����ֵ�����

��3�����D(zhu��n)��һ�v܇�����D(zhu��n)������ͬһ�v܇�����D(zhu��n)��������(hu��)�в�ͬ���c(di��n)�ƴ���ͬһ�v܇

Princeton��s Modelnet40 dataset�� �������s40��(g��)��(du��)��e�����w�C(j��)���������������ֲ��ȣ��������������ξW(w��ng)���ʾ��12311��(g��)CADģ����� ��(sh��)��(j��)�֞�9843��(g��)��Ӗ(x��n)ģʽ��2468��(g��)�y(c��)ԇģʽ�����D

���c(di��n)���ϑ�(y��ng)����ȌW(xu��)��(x��)��ֱ�ӷ����nj���(sh��)��(j��)�D(zhu��n)�Q���w�e��ʾ���� �����w�ؾW(w��ng)�������� �@���҂��Ϳ����Û]����(j��ng)�W(w��ng)�j(lu��)���}��3D�V������Ӗ(x��n)��һ��(g��)CNN���W(w��ng)���ṩ�˽Y(ji��)��(g��u)���W(w��ng)����D(zhu��n)�Q��Q�����І��}��������w�صĔ�(sh��)��Ҳ�Dz�׃�ģ���� ���ǣ��@��һЩ����������� �w�e��(sh��)��(j��)����׃�÷dz�����������dz��������� �҂����]256��256 = 65536���صĵ��͈D���С�����F(xi��n)���҂�����һ��(g��)�S��256x256x256 = 16777216�w�ء� �@�Ǻܴ�Ĕ�(sh��)��(j��)�����M��GPUһֱ�ڰl(f��)չ��������� �@Ҳ��ζ���dz�������̎��r(sh��)�g��� ���������ͨ���҂���Ҫ�ׅf(xi��)����ȡ�^�͵ķֱ��ʣ�һЩ����ʹ��64x64x64���������������������`��Ĵ��r(ji��)�������������������Ľ�Q������һ��(g��)ֱ�ӵ���ȌW(xu��)��(x��)�ķ�����������3D�c(di��n)�Ƒ�(y��ng)����ȌW(xu��)��(x��)�����c(di��n)��

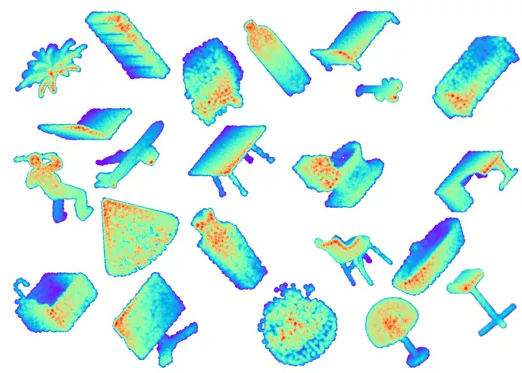

�����{(di��o)�������N����l(f��)�������£���Ҫᘌ�(du��)��(du��)�c(di��n)���M(j��n)����ȌW(xu��)��(x��)��Փ�ġ� �����D��ʾ�����չʾ��3D�c(di��n)�Ʒ��(zh��n)�_�Գ��棨��(zh��n)�_�ԣ���ݺ͔�(sh��)��(j��)��ͣ��������Y(ji��)�˔�(sh��)��(j��)���ϵ�����(zh��n)�_�ԽY(ji��)������� �Լ�ÿ�N��������̎���Ĕ�(sh��)��(j��)����͡� ���Կ�������2015�꣬�����(sh��)���������ڶ�ҕ�D��(sh��)��(j��)���@��һ�N��(ji��n)�̵��f�� - �҂��Ĕz3Dģ�͵Ď���Ƭ��ʹ��2D����̎���������������2016�����ķ���ʹ�����w�ر�ʾ���c(di��n)�ƌW(xu��)��(x��)��2017��Ļ����c(di��n)�ķ������˴���ȵ����L(zh��ng)������

PointNet��CVPR2017��

�_���ߣ� ����˹̹����W(xu��)�������Ĺ��������˺ܶ��P(gu��n)ע��������������һЩ�����@Ӡ�ĺ�(ji��n)�ε������������C���˞�ʲô���\(y��n)�����ã������քe��ÿ��(g��)�c(di��n)��Ӗ(x��n)����һ��(g��)MLP�����c(di��n)֮�g�����(qu��n)�أ�����ÿ��(g��)�c(di��n)����ͶӰ����һ��(g��)1024�S���g���Ȼ������������c(di��n)��(du��)�Q����(sh��)��max-pool����Q���c(di��n)������}���@��ÿ��(g��)�c(di��n)���ṩ��һ��(g��)1 x 1024��ȫ���������@Щ�����c(di��n)������Ǿ��Է��������������������Q��T-net�ġ�����W(w��ng)�j(lu��)����Q�����D(zhu��n)���}�����W(xu��)��(x��)���c(di��n)��3 x 3�����м�(j��)������64 x 64���ϵ�׃�Q��ꇡ��Q֮�顰���㡱���c(di��n)���`����������?y��n)����?sh��)�H���c���W(w��ng)�j(lu��)�Ĵ�С���P(gu��n)�������������������څ���(sh��)��(sh��)���Ĵ������ӣ�������һ��(g��)�pʧ�(xi��ng)���s��64��64��ꇽӽ�������Ҳʹ����ƵľW(w��ng)�j(lu��)�M(j��n)������ָ�������Ҳ���ˈ�(ch��ng)���Z�x�ָ�������ú���������ҏ�(qi��ng)�����]��x��������Ҳ�����^����ʾҕ�l������������Č�(du��)ModelNet40��(sh��)��(j��)���Ĝ�(zh��n)�_�ʸ��_(d��)89.2�����D��pointNet�c(di��n)�Ʒ�Ŀ��

Pointnet ++��NIPS 2017��

��PointNet֮�ã�������Pointnet ++���������|(zh��)����PointNet�ķӰ汾���ÿ��(g��)�D�Ӷ�������(g��)���A�Σ��ɘӣ��ֽM��PointNeting���ڵ�һ�A��������x���|(zh��)������ڵڶ��A�Σ��������܇��������c(di��n)���ڽo���İ돽��(n��i)����(chu��ng)������(g��)���c(di��n)���������Ȼ�������������o��һ��(g��)PointNet�W(w��ng)�j(lu��)����������@���@Щ���c(di��n)�Ƶĸ��߾S��ʾ���Ȼ������������؏�(f��)�@��(g��)�^�̣��ӱ��|(zh��)�������ҵ����������Ӻ�Pointnet�ĸ����A�ı�ʾ������ԫ@�ø��߾S��ʾ�������ʹ���@Щ�W(w��ng)�j(lu��)���е�3��(g��)�������߀�y(c��)ԇ�˲�ͬ�Ӽ�(j��)��һЩ��ͬ�ۺϷ������Կ˷��ɘ��ܶȵIJ����(du��)�ڴ����(sh��)���������f�@��һ��(g��)���}�����(d��ng)���w�ӽ��r(sh��)�ܼ��ӱ���������h(yu��n)̎�r(sh��)ϡ�裩������?c��)�ԭ��PointNet���M(j��n)���˸��M(j��n)�������ModelNet40�ϵĜ�(zh��n)�_���_(d��)����90.7����������Pointnet++ �ܘ�(g��u)����

|